Différentes Approches IA générative

Publiée le septembre 24, 2025

Publiée le septembre 24, 2025

L’intelligence artificielle générative repose sur plusieurs grandes familles de modèles, chacune ayant ses propres mécanismes, ses points forts et ses limites. Voici les approches les plus couramment utilisées aujourd’hui.

Les modèles de langage de grande taille sont principalement utilisés pour :

La génération de texte (articles, contenus marketing, réponses conversationnelles).

La programmation assistée et la génération de code.

La rédaction de résumés, notes ou rapports.

Les chatbots intelligents et assistants métiers.

Un LLM prédit le prochain mot ou token dans une séquence en se basant sur les précédents. Cependant, ces modèles peuvent “halluciner” en produisant des informations erronées. Pour pallier ce problème, on combine le LLM avec le RAG (Retrieval-Augmented Generation) : avant de répondre, le modèle interroge une base documentaire externe (documents internes, bases de données, sites web) pour enrichir sa génération avec des faits réels et à jour.

Capacité à répondre aux besoins concrets des entreprises : automatisation, recherche d’information, support client.

Amélioration de la fiabilité et réduction des erreurs factuelles grâce au RAG.

Flexibilité d’intégration dans des environnements métiers variés.

ChatGPT (GPT-4), Claude d’Anthropic, ou encore LLaMA associé à un module RAG.

Ces modèles dominent aujourd’hui la génération de contenus visuels et multimédias :

Images et illustrations réalistes.

Vidéos courtes ou longues.

Audio et voix.

Objets et scènes en 3D.

La diffusion fonctionne en sens inverse du bruit. On part d’une image bruitée aléatoire et le modèle apprend à la “nettoyer” étape par étape, jusqu’à produire une image cohérente et fidèle.

Qualité visuelle exceptionnelle, capable de rivaliser avec des photographies.

Grande créativité : idéal pour le design, le marketing, l’architecture ou le divertissement.

Forte adoption dans les industries créatives grâce à des outils accessibles.

Stable Diffusion, DALL·E, MidJourney, et Sora (génération vidéo par OpenAI).

Les VAEs trouvent leur place dans :

La génération d’images simples et stylisées.

La création de données synthétiques pour entraîner d’autres modèles.

Les domaines scientifiques, notamment en biologie, chimie ou génétique.

Un VAE encode les données dans un espace latent probabiliste, puis les reconstruit à partir de cet espace. Cela permet non seulement de reproduire des données proches de celles d’origine, mais aussi d’explorer de nouvelles variations.

Simplicité de conception et rapidité d’entraînement.

Idéal pour explorer et manipuler des représentations latentes, par exemple interpoler entre deux images ou générer des versions variées d’un même objet.

Moins coûteux que les approches de type GAN ou diffusion.

Les VAEs de base, ou les variantes comme le VQ-VAE, souvent combinés à d’autres techniques.

Les GANs sont spécialisés dans la génération d’images très réalistes et la transformation visuelle :

Création d’images haute fidélité.

Translation d’images : changement de style, ajout d’effets, transformation d’une image vers une autre.

Super-résolution : amélioration de la qualité d’images existantes.

Le GAN repose sur un jeu à deux acteurs :

Un générateur qui produit de nouvelles images.

Un discriminateur qui tente de distinguer ces images des vraies données.

Au fil de l’entraînement, le générateur devient de plus en plus habile à créer du contenu indiscernable du réel.

Résultats nets et réalistes, particulièrement sur les images fixes.

Entraînement plus rapide que les modèles de diffusion pour certaines tâches.

Moins coûteux en ressources dans des cas ciblés.

StyleGAN (qualité photo exceptionnelle), CycleGAN (translation d’images), BigGAN (images haute fidélité à grande échelle).

Moins connus du grand public, les flows sont utilisés pour :

La génération d’audio et de voix de haute qualité (vocodeurs).

La modélisation scientifique et statistique.

Des applications nécessitant un calcul de probabilité précis.

Un normalizing flow transforme une distribution simple (comme le bruit gaussien) en une distribution complexe qui correspond aux données réelles. Ce processus est réversible, ce qui permet de calculer directement la probabilité de chaque échantillon généré.

Permet un contrôle précis sur les données générées.

Offre une densité probabiliste explicite, ce qui est utile pour des applications scientifiques ou de sécurité.

Moins courant que diffusion ou GAN, mais efficace dans certains contextes.

Glow, RealNVP, WaveGlow (vocodeur audio).

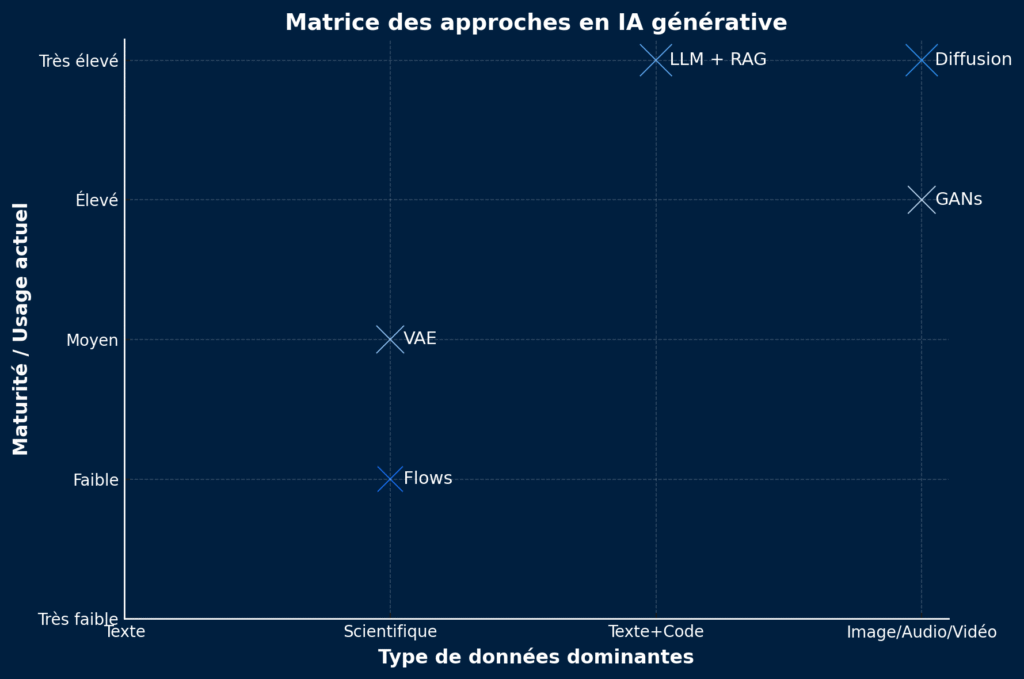

👉 Lecture rapide :

LLM + RAG → standard pour texte et connaissance.

Diffusion → référence pour images/vidéos haute qualité.

VAE → exploratoire, scientifique, plus léger.

GANs → efficaces pour tâches visuelles ciblées.

Flows → utilisés dans audio et science

| Approche | Usages dominants | Forces | Limites |

|---|---|---|---|

| LLM + RAG (Large Language Models + Retrieval-Augmented Generation) | Texte, code, chatbots, assistants métier | – Réduction des hallucinations- Actualisation des connaissances en temps réel- Très polyvalent | – Dépendance à la qualité des bases documentaires- Coût de calcul élevé |

| Diffusion | Images, vidéos, audio, 3D | – Qualité visuelle/photo-réaliste- Grande créativité- Contrôle fin (ControlNet, guidance) | – Très coûteux en GPU- Temps de génération parfois long- Risques éthiques (deepfakes) |

| VAE (Variational Autoencoders) | Données synthétiques, compression, recherche scientifique | – Légers et rapides à entraîner- Espaces latents interprétables- Bon pour l’interpolation | – Moins réalistes que GAN/diffusion- Usage limité en production |

| GANs (Generative Adversarial Networks) | Images haute fidélité, super-résolution, style transfer | – Résultats nets et réalistes- Rapides pour certains cas (ex. SR)- Bien établis en recherche | – Instabilité à l’entraînement- Mode collapse possible- Moins flexibles que diffusion |

| Flows (Normalizing Flows) | Audio (vocodeurs), modélisation scientifique, densité exacte | – Probabilité explicite- Génération réversible- Utile pour audio et sciences | – Complexité des architectures- Moins adoptés que LLM/diffusion |